Więcej niż „fajny efekt”: 4 filary bezpiecznego AI, o których musisz wiedzieć, zanim wdrożysz je w swoim biznesie.

„Fajne” narzędzia AI to za mało. Sprawdź, jak weryfikować dostawców pod kątem jurysdykcji danych i standardów SOC 2. Dowiedz się, dlaczego lokalizacja serwerów i etyka modelu AI decydują o bezpieczeństwie Twojego biznesu.

1/24/20267 min read

Wprowadzenie sztucznej inteligencji do codziennej operacji firmy przypomina budowę inteligentnego domu. Możemy skupić się na estetyce elewacji i nowoczesnych meblach (czyli funkcjach AI, które dają efekt „wow”), ale jeśli fundamenty są z piasku, a zamek w drzwiach jest z plastiku – cała konstrukcja prędzej czy później runie. W świecie cyfrowym tą ruiną jest wyciek danych klientów, kradzież tożsamości biometrycznej lub utrata praw autorskich do własnych materiałów.

Ja jako przedsiębiorca i asystentka działająca w 2026 roku, wiem że nie mogę już ufać aplikacjom „na słowo”. Ty również nie możesz, a na pewno nie powinieneś. Musisz potrafić czytać mapę cyfrowego bezpieczeństwa i rozumieć, dlaczego certyfikacja SOC 2 czy lokalizacja serwerów to nie nudna biurokracja, ale Twoja najważniejsza polisa ubezpieczeniowa.

1. Standardy SOC 2 i ISO 27001 – Cyfrowy certyfikat zaufania, który chroni Twoją firmę i wizerunek.

Różnica między SOC 2 Type I a Type II

Warto zrozumieć tę subtelną, ale kluczową różnicę:

Type I: Opisuje systemy firmy w jednym, konkretnym dniu. To jak zdjęcie zamka w drzwiach – pokazuje, że w momencie robienia fotki, zamek tam był.

Type II: To dokument o wiele wyższej wadze. Potwierdza on, że zabezpieczenia działały skutecznie przez dłuższy okres (zazwyczaj od 6 do 12 miesięcy). To dowód na to, że firma żyje standardami bezpieczeństwa na co dzień, a nie tylko „posprzątała” na wizytę audytora.

Jeśli narzędzie AI, którego używasz do generowania awatarów lub analizy strategii biznesowej, posiada SOC 2 Type II, oznacza to, że Twoje dane są chronione protokołami klasy bankowej. Audytor sprawdza m.in. jak firma reaguje na ataki, jak szyfruje dane w spoczynku i w drodze (in transit) oraz czy jej pracownicy mają odpowiednie uprawnienia.

ISO 27001 – Europejski znak jakości bezpieczeństwa

O ile SOC 2 to standard wywodzący się z USA (kluczowy, jeśli korzystasz z narzędzi takich jak Google, Microsoft czy OpenAI), o tyle w Europie króluje ISO 27001.

Czym różni się od SOC 2?

SOC 2 mówi: "Mamy wdrożone konkretne zabezpieczenia i działają one poprawnie" (to raport z dowodami).

ISO 27001 mówi: "Mamy cały system zarządzania bezpieczeństwem, który stale udoskonalamy" (to proces i certyfikat).

Dlaczego to ważne dla Ciebie? Wybierając narzędzia AI do swojej firmy, szukaj logotypów obu tych standardów. ISO 27001 to dla Ciebie gwarancja, że dostawca technologii nie traktuje bezpieczeństwa jako jednorazowego zadania, ale jako fundament swojej działalności. To najwyższa liga ochrony Twoich danych.

2. Jurysdykcja danych: Mapa, która decyduje o Twoim bezpieczeństwie

3. RODO a AI – Pułapka trenowania modeli

Największym zagrożeniem w 2026 roku nie jest sam haker, ale... regulamin aplikacji, który zaakceptowałaś bez czytania. Większość popularnych modeli AI domyślnie ustawia opcję wykorzystywania wprowadzanych danych do „doskonalenia algorytmów”.

Jeśli wrzucasz do czatu AI poufną umowę handlową, strategię rozwoju firmy na kolejny rok lub dane osobowe swoich kontrahentów, te informacje przestają być Twoją tajemnicą. Stają się częścią publicznej bazy wiedzy modelu. Istnieje ryzyko, że inny użytkownik, zadając odpowiednie pytanie, otrzyma odpowiedź wygenerowaną w oparciu o... Twoje poufne dane.

Jak się chronić? Profesjonalne narzędzia z certyfikatem SOC 2 oferują zazwyczaj tryb „Enterprise” lub specjalne ustawienia prywatności (Opt-out), które gwarantują, że Twoje dane są używane wyłącznie do Twoich celów i nigdy nie służą do trenowania ogólnodostępnego modelu.

4.Nowe prawo AI (AI Act) – o co w tym chodzi?

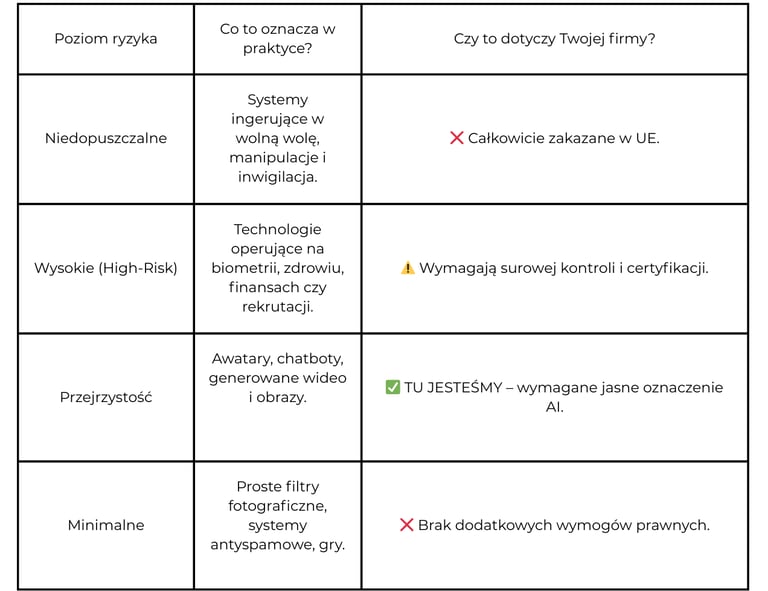

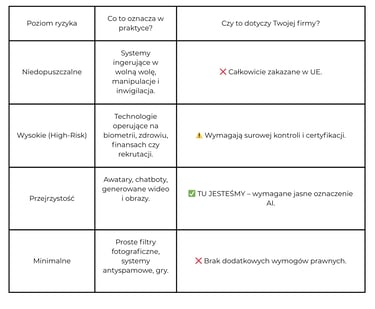

Unia Europejska jako pierwsza na świecie uregulowała sztuczną inteligencję. AI Act nie kontroluje bezpośrednio Twojej małej firmy, ale zmusza gigantów (Meta, Google, TikTok) do surowego filtrowania treści.

Dlaczego to dotyczy Twoich social mediów? Największe ryzyko to nagły ban na Instagramie lub Facebooku. Algorytmy już teraz potrafią wykryć „podejrzane” AI. Jeśli Twój awatar nie ma zakodowanych odpowiednich oznaczeń lub jego pochodzenie jest niejasne, ryzykujesz skasowanie konta z dnia na dzień.

Ryzyko niedopuszczalne: Systemy ingerujące w wolną wolę (całkowicie zakazane).

Wysokie ryzyko: Tu znajdują się technologie operujące na biometrii (Twoim wizerunku i głosie), zdrowiu czy edukacji. Podlegają one najsurowszej kontroli.

Niskie ryzyko: Proste chatboty czy filtry antyspamowe.

Co musisz wiedzieć o awatarach? Profesjonalne narzędzia (których używam w Asystentka z AI) dają Ci bezpieczeństwo, bo oferują:

Cyfrowy watermark w metadanych – ukryty kod w pliku, dzięki któremu Instagram wie: „To legalne AI”.

DPA + pełne prawa do wizerunku – darmowe apki „kradną” Twoją twarz do treningu swoich modeli. U mnie Twoja twarz należy tylko do Ciebie.

Zgodność z obowiązkiem przejrzystości – prawo wymaga, by odbiorca wiedział, że widzi AI. Mój system ułatwia to oznaczenie, chroniąc Cię przed zarzutem wprowadzania w błąd (UOKiK).

Twoje bezpieczeństwo, Twój spokój

W dobie cyfrowej transformacji, w której każdy może stworzyć awatara lub wygenerować tekst w kilka sekund, prawdziwą walutą rynkową staje się odpowiedzialność. Często słyszymy, że „dane to nowa ropa naftowa”, ale zapominamy, że nieodpowiednio przechowywana ropa staje się toksycznym wyciekiem, który potrafi zniszczyć ekosystem marki w jedną noc.

Inwestycja w narzędzia posiadające certyfikację SOC 2 Type II, rygorystyczne podejście do jurysdykcji danych oraz pełna zgodność z nadchodzącym AI Act, to nie tylko techniczny wymóg. To przede wszystkim deklaracja szacunku wobec Twoich klientów, partnerów biznesowych, ale też – co równie ważne – wobec samej siebie.

Wybierając rozwiązania z najwyższej półki certyfikacyjnej, dbasz o swój własny, cyfrowy spokój. Pamiętaj, że w relacji z AI to Ty jesteś pierwszą linią obrony swojej prywatności. Każda aplikacja, której udostępniasz swój wizerunek, głos czy poufne myśli, staje się powiernikiem Twojej tożsamości. Dbanie o własne bezpieczeństwo cyfrowe i świadome filtrowanie narzędzi przez pryzmat ich pochodzenia to nie lękowy nawyk, lecz wyraz najwyższej profesjonalnej dojrzałości.

W świecie, gdzie granica między prawdą a cyfrową manipulacją staje się coraz cieńsza, transparentność w zakresie tego, jak i gdzie przetwarzamy informacje, będzie jedynym skutecznym wyróżnikiem profesjonalizmu. Jako przedsiębiorcy i asystentki nowej generacji, mamy obowiązek stać na straży standardów, które wykraczają poza „fajny efekt”. Bezpieczeństwo danych to jedyna droga do tego, by technologia AI realnie nas wspierała, zamiast stawać się źródłem nieprzewidzianych zagrożeń prawnych, wizerunkowych i osobistych.

W dobie chmury łatwo zapomnieć, że „chmura” to po prostu czyjś komputer w konkretnym miejscu na świecie. Kraj pochodzenia aplikacji i lokalizacja serwerów mają krytyczne znaczenie dla Twojego bezpieczeństwa prawnego i ciągłości biznesu.

USA: Data Privacy Framework i wyzwania

Stany Zjednoczone to kolebka innowacji AI, ale ich podejście do prywatności różni się od europejskiego. Obecnie transfer danych między UE a USA opiera się na porozumieniu Data Privacy Framework (DPF- ). Dzięki niemu amerykańscy giganci (jak Google czy Microsoft) mogą gwarantować standardy ochrony zbliżone do RODO.

Jednak jako profesjonalny użytkownik musisz wiedzieć o istnieniu Cloud Act. To amerykańskie prawo, które pozwala tamtejszym służbom (np. FBI) żądać dostępu do danych przechowywanych przez amerykańskie firmy, nawet jeśli serwery znajdują się w Europie

I tu ważne doprecyzowanie: Cloud Act pozwala władzom USA na dostęp do danych firm amerykańskich tylko w sprawach ciężkich przestępstw (terroryzm, cyberprzestępczość) i wymaga nakazu sądowego, nie interesują ich codzienne operacje małej firmy.

Mimo to, w ramach usługi Asystentka z AI wdrażam u Ciebie profesjonalne wersje biznesowe (Enterprise/Business). Dlaczego? Ponieważ posiadają one pełne szyfrowanie i umowy DPA (Umowa Powierzenia Przetwarzania Danych ang. Data Processing Agreement). Twoje dane są izolowane, a dostęp służb poza skrajnymi przypadkami – prawnie ograniczony. Darmowe aplikacje tego nie gwarantują.

Europa: RODO (GDPR) jako tarcza

Dla polskiej firmy serwery zlokalizowane w Unii Europejskiej (Niemcy, Irlandia, Francja) to najbezpieczniejszy wybór. RODO to obecnie najsurowszy standard ochrony prywatności na świecie. Wybierając narzędzia hostowane w UE, automatycznie spełniasz szereg wymogów prawnych, które chronią Cię przed gigantycznymi karami finansowymi ze strony organów nadzorczych.

Kraje wysokiego ryzyka: Pułapka darmowych narzędzi

Często spotykamy „cudowne” aplikacje do generowania twarzy lub automatyzacji procesów, które są całkowicie darmowe lub podejrzanie tanie. Wiele z nich pochodzi z krajów o niejasnym systemie prawnym lub autorytarnym. Musisz mieć świadomość, że w takich jurysdykcjach prywatna firma często nie ma prawa odmówić rządowi dostępu do swoich baz danych. Twoja twarz, głos Twojej klientki czy poufne bazy mailowe mogą zostać wykorzystane do trenowania algorytmów inwigilacyjnych lub innych działań naruszających etykę biznesu.

Nieufność to dziś przejaw rozwagi

W świecie, gdzie technologia AI rozwija się szybciej niż nasze prawo, ślepa ufność bywa kosztowna. Jako Twoja Asystentka z AI, uważam, że kwestionowanie darmowych narzędzi i sprawdzanie źródeł to nie sceptycyzm – to dowód dojrzałości.

Nie chcę, abyś wierzyła mi „na słowo”. Dlatego podaję Ci źródła które sprawdziłam, pisząc i redagując ten artykuł.

Oficjalny Serwis UE o AI Act: Artificial Intelligence Act - High-level Summary – tu znajdziesz proste wyjaśnienie poziomów ryzyka, o których pisałyśmy.

Baza wiedzy Komisji Europejskiej: AI Act Service Desk – oficjalne centrum informacji dla firm wdrażających AI.

Analiza CLOUD Act vs RODO: CLOUD Act vs. GDPR (ActiveMind) – świetne, eksperckie porównanie pokazujące, dlaczego te dwa systemy prawne ze sobą „walczą”.

Moja decyzja o odrzuceniu tanich apek z Chin Analiza prawna Lawfare – szczegółowy opis ryzyka związanego z przekazywaniem danych biometrycznych na Wschód.

1. Sprawdzenie „papiery na bezpieczeństwo”

Jeśli aplikacja jest z USA, wchodzisz tutaj: 👉 Data Privacy Framework - Participant Search

Co robisz? Wpisujesz nazwę firmy (np. Canva, OpenAI, Google) w wyszukiwarkę.

Na co patrzysz? Musi pojawić się status ACTIVE. Jeśli firmy nie ma na liście, oznacza to, że nie daje ona gwarancji ochrony danych wymaganych przez RODO.

Zanim w ogóle klikniesz w jakikolwiek link, sprawdź stopkę strony (na samym dole):

Jeśli widzisz siedzibę w Chinach, Rosji lub na Seszelach: Odpuść. Te firmy nie podlegają pod RODO ani pod DPF. Ryzykujesz utratę biometrii (twarzy).

Szukaj „DPA” lub „GDPR”: Jeśli na stronie nie ma zakładki „Privacy Policy” z dopiskiem o RODO (GDPR) lub DPA, to znak, że to zabawka, a nie narzędzie do biznesu.

Słowo na koniec: Jak powstał ten artykuł?

Transparentność to dla mnie podstawa, dlatego chcę Ci zdradzić mały sekret: przy pisaniu i redakcji tego artykułu wspierały mnie dwie różne sztuczne inteligencje. Wybrałam je nieprzypadkowo, dbając o najwyższe standardy, o których czytałaś powyżej:

AI numer 1: To mój „prywatny doradca”, który bezpiecznie mieszka lokalnie na moim dysku. Dzięki temu mam 100% pewności, że żadne poufne dane nie opuszczają mojego komputera i nie są wykorzystywane do trenowania publicznych modeli.

AI numer 2: To mój „cyfrowy badacz”, który ma stały dostęp do sieci i na bieżąco weryfikuje dane, linki oraz zmiany w prawie (jak AI Act czy certyfikaty DPF).

To połączenie ludzkiej kreatywności z bezpieczną technologią to właśnie model pracy, który wdrażam u moich klientek. Ale ... to już zupełnie inna historia, którą chętnie Ci opowiem.